כך תגנו על המוח שלכם מפלישת המכונות

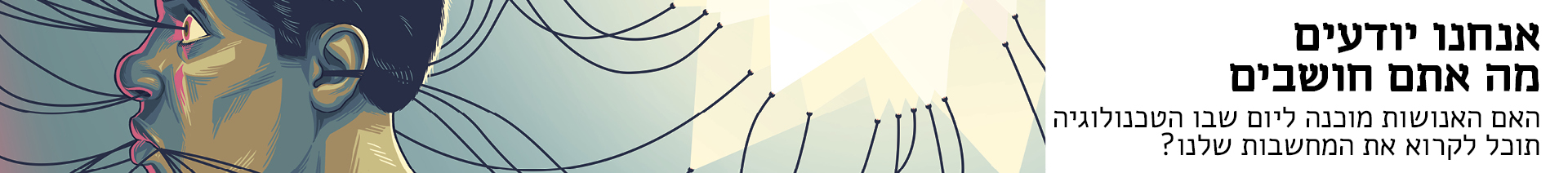

פייסבוק תקרא את המחשבות שלנו, המעסיקים יעקבו אחרי הפעילות המוחית כדי לגלות כמה אנחנו פרודוקטיביים, והתקנים חדשניים יוכלו לשנות את ה"אני" שלנו. "עידן המוח", שבו הטכנולוגיה תפענח מה קורה בתוך הראש שלנו, מחייב הגדרה חדשה של זכויות האדם. ד"ר מרצ'לו איינקה, מהמומחים המובילים בעולם לנושא, מנסח את ארבעת הכללים שישמרו על המוח שלנו מפלישה, חיטוט וחטיפה

שומר למחשבה

ויקי אוסלנדר

איור: דניאל גולדפרב

אלון מאסק, יזם בלתי נדלה, התגאה בקיץ האחרון בפריצת דרך במה שהוא, להגדרתו, "מאמץ אחרון בקרב על האנושות". Neuralink היא החברה של מאסק שאחראית למאמץ האחרון הזה — לשמור על בני האדם מפני ניצחון המכונות — והיא עושה זאת דווקא באמצעות מכונות, בתחום של ממשק מוח־מחשב. היזם מבטיח שבעזרת מדעי המוח ובינה מלאכותית החברה מפתחת כלים שיגבירו את יכולות הקוגניציה האנושית. בינתיים, ביולי האחרון הוא כבר הציג פיתוח משמעותי ראשון: מערך אלקטרודות גמישות ודקיקות (6-4 מיקרומטר, פחות מעובי שערה) שאפשר לפרוס על הראש כדי שיקלטו פעילות מוחית: דיבור, ראייה, שמיעה או תנועה. הכלי הזה מאפשר לקלוט מידע מהמוח וגם לשדר אליו מידע, והוא כבר נוסה על קוף. לפי מאסק, עד סוף השנה ינוסה גם על בני אדם.

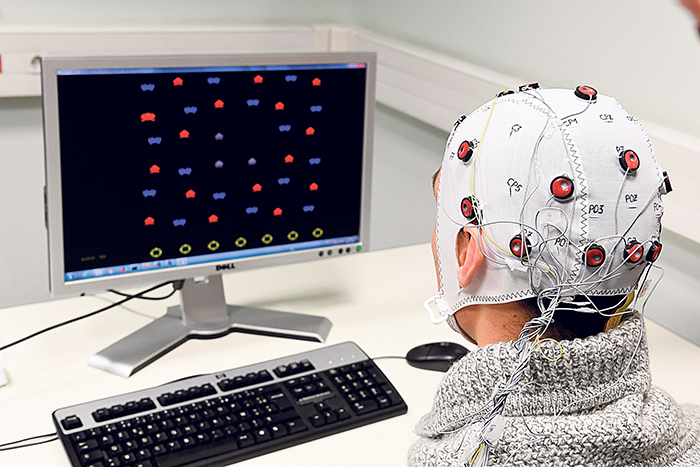

בניגוד לכמה יוזמות אחרות של מאסק, זו כבר מיושמת בשטח. לא הפיתוח הספציפי של ניורלינק, אבל כן פיתוחים דומים. בסין, למשל. יש עדויות מאומתות כי שתי חברות סיניות ממשלתיות — מפעל לאנרגיה גרעינית וחברת רכבות מהירות — מבקשות מעובדים לחבוש התקנים נוירו־טכנולוגיים כדי לנטר את הפעילות המוחית שלהם ואת רמות הריכוז בזמן העבודה, הכל כדי להגדיל את הפריון. ולא רק עובדים: לפי דיווחים אחרים, בסין ניהלו פרויקט שבו מורים השתמשו באמצעים נוירו־טכנולוגיים כדי לנטר את הריכוז של תלמידים. המחקר הזה נסגר רק בעקבות ביקורת ציבורית.

ומה שקורה במפעלים בסין קרוב מאוד לקרות גם בסמארטפון שלכם. פייסבוק כבר פועלת בתחום של ממשק מוח־מחשב או מוח־מכונה (BCI או BMI), ומפתחת מערכת לבישה לא פולשנית ש"קוראת מחשבות". המערכת אמורה לפענח את הנעשה במרכז הדיבור במוח ולזהות מילים שהאדם חושב עליהן. המטרה היא לקלוט עד 100 מילים בדקה, שאותן המערכת תזין בעצמה — ללא התערבות אנושית, בלי שהאדם יאמר את המילים או יקליד אותן — לאחת הפלטפורמות של פייסבוק. באוגוסט הודיעה החברה על הצלחת ניסוי שבו האלגוריתם שבנתה לצורך העניין זיהה בזמן אמת מילים שעליהן חשבו נסיינים בשיעור דיוק של 61%.

ד"ר מרצ'לו אִייֵנקה (Marcello Ienca) מודאג מאוד מכל זה. פייסבוק וחברות דומות הרי מחזיקות כבר עכשיו במאגר ידע אדיר על המשתמשים שלהן. כשהן יתחילו לאסוף מידע גם על המוח שלהם, החברות האלה יוכלו ליצור פרופילים פסיכולוגיים מורכבים של מיליארדי אנשים, לסחור במידע הזה, להשתמש בו כדי לעשות מניפולציות על הלקוחות, וכל זה בלי שנהיה מודעים לכך.

איינקה. "חייבים להיערך כבר עכשיו ליום שבו הטכנולוגיה תוכל לקרוא את המוח שלנו". צילום: Daniel Kellenberger

"פייסבוק אומרת שהיא מפתחת ממשק מוח־מכונה מסחרי כדי שהמשתמשים שלה יוכלו להתחבר לפרופיל שלהם ולפיד באמצעות פעילות המוח, וזה יהיה מהיר הרבה יותר מגלישה באמצעות הידיים", אומר איינקה בראיון בלעדי ל"מוסף כלכליסט". כשהתרחיש הזה ייהפך למציאות, החברה תקבל גישה לפעילות המוחית של מיליוני אנשים. היא תוכל, למשל, לזהות את האותות החשמליים P300, שמזנקים בכל פעם שהמוח מזהה משהו ששווה לשים לב אליו, וכך ללמוד את ההעדפות שלנו, גם הנסתרות, לזהות העדפות פוליטיות, דתיות או מיניות. זה מידע שבמדינות מסוימות יכול לשים אותך מאחורי סורג ובריח".

זה רק תרחיש אימים אחד שמסתתר באופק של "עידן המוח", שבפתחו אנחנו נמצאים. ממשקי מוח־מכונה הם חזית המחקר והפיתוח הן בגופים ממשלתיים והן בחברות פרטיות. עוד ועוד מדינות, חברות ומדענים משכללים את הטכנולוגיות שמאפשרות "לקרוא" מוח של אדם או להפעיל אותו, והטכנולוגיות האלה יכולות לשמש לשיפור איכות החיים (למשל של נכים) אבל גם לצרכים מסחריים, שלטוניים וביטחוניים.

מאסק. הציג אלקטרודות שאפשר לפרוס על הראש כדי לקלוט פעילות מוחית: דיבור, ראייה וכו'

צילום: אי.פי

צוקרברג. מפתח מערכת שקוראת מילים ישירות מהמוח

צילום: גטי אימג'ס

כלים כאלה כבר קיימים ונמצאים בשימוש ראשוני, ונראה שלשימוש הפוטנציאלי בהם אין גבול. זה מה שמעסיק את איינקה: לשרטט את הגבולות האלה, שיגנו על המוח שלנו מפני קריאת מחשבות או מניפולציות. הוא אחד המומחים המובילים בעולם לנוירו־אתיקה, לשאלות המוסריות שעולות מטכנולוגיה שמכוונת לפענוח המוח האנושי או להשפעה עליו. בראיון מטריד הוא מתאר את הסיכונים בטכנולוגיות האלה, וכיצד לנטרל אותם. איינקה פועל עם ה־OECD להחלת כללים ברורים בתחום ואפילו ניסח ארבע זכויות אדם חדשות, שנועדו לשמור על חירות ופרטיות המחשבות, הנטיות וההעדפות שלנו, לפני שמישהו ייכנס לנו לתוך הראש. "אנחנו חייבים להיערך כבר עכשיו ליום שבו הטכנולוגיה תוכל לקרוא את המוח שלנו, ולהגדיר את שומרי הסף", הוא אומר.

שליטה וחירות

"אינך יכול לגעת בחופש של התודעה שלי" (my mind), כתב המשורר האנגלי ג'ון מילטון במאה ה־17. ואמנם, במשך אלפי שנים מחשבות היו אזור פרטי מוגן, שאף אחד אינו יכול לגעת בו (וגם השליטה של האדם עצמו עליהן מוגבלת למדי). אבל ככל שחקר המוח התקדם, ולצדו התחומים של למידת המכונה ובינה מלאכותית, כך צמחה טכנולוגיה שיודעת לזהות מחשבות בראשו של אדם, ולעתים אף לשנות את התנהגותו.

לכלים של ניורו־טכנולוגיה יש השפעה עמוקה על הזהות. חולים מדווחים על שינויים בתחושת העצמי כשההתקן מופעל, אחרים מרגישים שהם עצמם רק כשהוא פועל"

היא התפתחה לא רק במעבדות של אלון מאסק ושל מארק צוקרברג, ולא רק כניסיון למשטר את אזרחי סין. למעשה היא התחילה בגופי שלטון במערב. DARPA (דארפ"א), הסוכנות הממשלתית האמריקאית למחקר ופרויקטים מתקדמים בתחום ההגנה, מנסה מאז שנות השישים "לקרוא מחשבות" ולאפשר שליטה מחשבתית מרחוק. קרוב לוודאי שהגוף הזה — שבין השאר פיתח את האינטרנט, ה־GPS ומטוסי חמקן — יצא לדרך עם חלום על מרגלים טלפתיים ועל חיילים שנלחמים בכוח המחשבה. במשך שנים הרעיונות האלה זכו לבוז (לצד לא מעט רעיונות משונים אחרים שנולדו שם ונכשלו), אבל דארפ"א חזרה אליהם שוב ושוב, שואפת "לשחרר את התודעה ממגבלות הגוף". ב־2012 היא הציגה הישג מרשים: "שאלו אותי אם יש משהו ספציפי שאני רוצה להגשים, ללטף את לחי ילדיי או להחזיק את ידו של בן זוגי, ואני אמרתי שהמטרה שלי היא להאכיל את עצמי בשוקולד", אמרה ג'ן שוורמן, משותקת בארבעת גפיה, למצלמה בסרטון מ־2012. ואז, באמצעות כבלים שחוברו למוחה, הניעה שוורמן יד רובוטית שהגישה שוקולד לפיה. שלוש שנים אחר כך, בסרטון אחר של דארפ"א, הפעילה שוורמן, באמצעות המוח בלבד, סימולטור של מטוס קרב. בשנים הקרובות הטכנולוגיות האלה יתרבו, ישתכללו ויגבירו את היכולת האנושית לפענח את המידע החשמלי במוח, ואף לעשות בו מניפולציות.

"קוראים לזה 'נוירו־קפיטליזם', וחברות רבות מנסות כיום לבנות את המודל העסקי שלהן סביב נוירו־טכנולוגיה", אומר איינקה. "מספר הפטנטים בתחום זינק וכך גם מספר החברות הפועלות בו. נכנסו אליו כמה שחקניות ענקיות, וההשקעה בו צמחה מאוד". הפוטנציאל אדיר, וחלק מהכלים שכבר קיימים מעידים על השימושים החיוביים שטמונים בתחום — הטכנולוגיות האלה מאפשרות לאנשים להפעיל כיסאות גלגלים ותותבות באמצעות המוח, מפענחות רצונות אצל פגועי דיבור, מגבירות את השמיעה והראייה אצל בעלי לקויות. איינקה מדגיש שהוא לא יוצא נגד כל הנעשה בענף. "אנחנו צריכים לשמר את ההתפתחות המואצת הזו", הוא אומר, "אבל אנחנו חייבים לוודא שהצמיחה הזאת כוללת חדשנות אחראית".

פלישה ותחושת העצמי

איינקה (31), יליד איטליה, הוא חוקר בכיר לנוירו־אתיקה באוניברסיטת ציריך, שווייץ. בידיעה שקשה לצפות מחברות מסחריות לגלות חדשנות אחראית, הוא דוחק בממשלות לבנות מסגרת רגולטורית לטכנולוגיה החדשה, כזאת שתשמור על חירות המחשבה במובן הישיר ביותר שלה. בין השאר הוא חבר מוביל בוועדת ההיגוי של ה־OECD בנושא, ובדצמבר פרסם הארגון סוף סוף מסמך מדיניות ראשון שאושר בידי כל המדינות החברות. המסמך קרא לממשלות וליזמים להבטיח חירות קוגניטיבית, לאפשר לאנשים לבחור איך והיכן יישמר המידע שלהם, לקדם שיתוף פעולה בינלאומי, ליצור מנגנונים של שקיפות, ולהבטיח לא לפתח טכנולוגיות שפוגעות באוטונומיה אישית.

הבהילות, איינקה מסביר, גדולה מתמיד, משום שכבר כיום ניכרות השפעות בעייתיות של הטכנולוגיה, למשל על תחושת העצמי. זה קורה אצל בני אדם מוגבלים בתנועה שמשתמשים בכלים נוירו־טכנולוגיים כדי להפעיל עזרים — פרוטזות, כיסאות גלגלים או זרועות רובוטיות (כפי שעשתה אותה שוורמן בניסוי של דארפ"א). חלק מהמשתמשים מעידים על שיבוש בתחושת השליטה: הם אינם בטוחים שהם אכן אלה שבחרו לבצע את הפעולה שבוצעה, או מרגישים שאמנם ביצעו אותה — אך לא בטוחים שרצו בה מלכתחילה.

שיבוש משמעותי עוד יותר נוגע לטכנולוגיית גירוי מוחי עמוק (Deep Brain Stimulation, או DBS), שיטת טיפול שנמצאה יעילה למי שמתמודדים עם פרקינסון או דיכאון — אבל התברר שלעתים היא גורמת לשינויים בתחושת העצמי של המטופלים. במחקר מרכזי מ־2017 עלו עוד ועוד עדויות כאלה אצל חולי פרקינסון: "אני כבר לא יכולה להיות אני האמיתי. אני לא יכולה להעמיד פנים (...) אני חושבת שהרגשתי שהאדם שהייתי מאז ההתערבות איכשהו התבונן במישהו אחר, אבל זה לא אני (...) בני המשפחה שלי אומרים שהם מתאבלים על אני הישן", סיפרה אחת המטופלות. מטופל אחר העיד כי הטיפול יצר אצלו רגישות רגשית בלתי נשלטת עד כדי "מצב היסטרי (...) איבדתי את האני האמיתי שלי". מטופל נוסף אמר שהזהות שלו סובלת מ"בריחת שתן רגשית". מנגד היו שטענו כי תחת הטיפול הם דווקא "מצאו את האני האמיתי" שלהם.

"זו טכנולוגיה מבטיחה מאוד, אבל היא גם מאוד טרנספורמטיבית", אומר איינקה. "לכלים רבים של BCI יש השפעה עמוקה על הזהות העצמית. חולים רבים מדווחים על שינויים בתחושת העצמי כשההתקן מופעל, ואילו אחרים מדווחים שהם מרגישים עצמם רק כשהוא פועל. זה מעלה שאלות פילוסופיות על זהות עצמית, כמו גם על האפשרות לשנות את הפונקציות הקוגניטיביות".

מדובר במקרה יוצא דופן שבו תחושת הזהות העצמי — ה"אני" — של אנשים נתונה בידי חברה פרטית שמייצרת את ההתקנים האלה ומפעילה אותם. והיא אפילו כפופה לכיול אוטומטי. "הדור האחרון של מכשירים לגירוי עמוק כולל טכנולוגיה של לולאה סגורה, שבה למידת מכונה אחראית לוויסות אוטומטי של הגירוי החשמלי, בהתאם למידע שהמכשיר מקליט", מסביר איינקה. "כך, במקום שמי שינתח את המידע יהיה המטפל — זה לא נוח, כי צריך לגשת לנוירולוג בכל פעם שצריך לכייל את המכשיר — יש כיול אוטומטי. המכונה מחליטה איך להעביר חשמל במוח שלך ובאיזה אופן לווסת את הנוירו־ביולוגיה שלך".

פייסבוק מפתחת ממשק מוח־מכונה מסחרי, ותוכל לקבל גישה לפעילות המוחית של מיליוני אנשים וכך ללמוד את ההעדפות שלנו, גם הנסתרות - פוליטיות, דתיות או מיניות"

עוד במוסף כלכליסט

השאלות כאן רבות מספור. מהו "אני", ומי שולט בו? האם אדם יכול להגביל את הניסיון להתערבות חיצונית ב"אני" שלו, במחשבות שלו, בפעולות שלו? מי יוכל לאסוף את המידע שנמצא בתוך המוח שלנו, לאגור אותו ולהשתמש בו? האם הוא יישלף בעתיד בכל ריאיון עבודה? האם אפשר יהיה לחנך אותנו, לשנות אותנו, להפוך אותנו לעובדים יעילים יותר ואזרחים טובים יותר, או אולי להעניש אותנו, באמצעות מניפולציות על המוח?

אלה סוגיות פילוסופיות ומוסריות, אבל גם קונקרטיות מאוד, טכניות, משפטיות וממשלתיות, ואיינקה עוסק בהן כבר שנים. הוא חוקר עטור פרסים שפרסם עד כה עשרות מאמרים בכתבי העת הנוירולוגיים המובילים, מרצה בשלל במות, מתראיין וכותב לכלי תקשורת פופולריים בנושא, וגם היה חבר הנהלה באגודה הבינלאומית לנוירו־טכנולוגיה. ולנוכח הדחיפות, הוא אינו היחיד שעוסק בתחום. BNCI Horizon 2020 הוא ארגון שמממן האיחוד האירופי, ושכולל חוקרים מאוניברסיטאות אוקספורד, וושינגטון, בראון, דיוק ומוסקבה, לצד המכון הטכנולוגי בבייג'ינג ועוד; הם עובדים מול החברות והגורמים הממשלתיים שפועלים בתחום ומסייעים בגיבוש קונצנזוס של המותר והאסור. בשלב זה רוב השיח מתקיים בגבולות האקדמיה, ובכל זאת הוא מתחיל לעורר את הדיון הציבורי הנדרש.

ריגול ופרטיות

הטכנולוגיה הפכה את הפרטיות לעניין נזיל למדי, ונדמה שהתרגלנו לשחיקה המתמדת בה. הרי כבר היום הסופרמרקט יודע בדיוק מה אנחנו קונים, חברת האשראי בקיאה בהרגלי הבילויים, והרשתות החברתיות מכירות אותנו טוב יותר מהחברים שלנו. אבל עידן המוח חושף אותנו להפרת פרטיות בסדר גודל שאין לנו דרך לדמיין. "נכון שכבר היום אנחנו יכולים לאסוף מידע רב על אנשים, אבל כשזה מגיע למידע מוחי אנחנו חוצים חזית חדשה של פרטיות", אומר איינקה. "היום היכולת שלנו לקרוא מידע רגיש ופרטי ממדידת גלי מוח מוגבלת. אנחנו אמנם לא יכולים לקרוא מחשבות — ובכל זאת אנחנו כבר יכולים לקרוא מידע רגיש מאוד. אני יכול למשל לזהות סימנים מוקדמים של אלצהיימר אצל מישהו שבכל ממד אחר הוא אינדיבידואל בריא קוגניטיבית. אם המידע הזה זולג לחברת ביטוח זה יכול להוביל לאפליה, אם הוא זולג למעסיק זה יכול לגרור פיטורים".

האפשרויות לשימוש זדוני במידע מהמוח הן רבות ומטרידות. התקני DBS שמופעלים על ידי בלוטות', למשל, חשופים לפריצות, Brainjacking. "חטיפת מוח" כזאת יכולים לבצע האקרים עצמאיים, סוכנויות אויב שמנסות ליצור שיבוש חברתי, גורמים ביטחוניים שמחפשים מידע, רשויות שרוצות יותר שליטה או תאגידים שמעוניינים למכור לנו יותר. ומה יקרה כשמי שינסה לעשות את זה "רוצה בטובתנו": רופאים שייזמו גירויים מוחיים גם ללא הסכמה, בני משפחה שיגרו את המוח שלנו כדי להכריח אותנו לטפל בתסמינים שסירבנו לטפל בהם? מה יישאר מהאוטונומיה, האותנטיות ותחושת השליטה אחרי כל אלה?

איינקה ועמיתיו עסוקים בתרגילים האלה, והם לא ממש היפותטיים. "צריך לזכור שכמו בכל תחום, המידע שאוספים היום לא נעלם. הוא מאוחסן ונשמר, ואפילו אם היום אנחנו יודעים לקרוא רק מעט מהמידע שנאסף בטכנולוגיות מיפוי מוח, בעוד 20 שנה, עם ההתקדמות בחומרה ובמודלים, נוכל לקרוא יותר ויותר. לכן חייבים לנסות, כבר עכשיו, להתכונן לקראת היום שבו המוח יהיה קריא".

הפיתוחים הטכנולוגיים, הוא מזכיר, תמיד מקדימים את הרגולציה. "זה ברור מאליו וזה לא בהכרח דבר רע. הטכנולוגיה צריכה לחדש מהר ככל האפשר, כדי להציע לאנשים פתרונות, אבל יש לה תופעות לוואי שמאפשרות לסוכנים רעים לשגשג". וסוכנים רעים יכולים להיות בכל מקום. "אני מודאג ממה שקורה בשוק הפרטי", אומר איינקה וחוזר לאפשרות הלא מופרכת שפייסבוק תקרא את המחשבות שלנו, ומציין שבמקביל "בתחום הצבאי יש פערים רגולטוריים בעייתיים". הוא מתייחס לפרויקטים שעושים שימוש במחשבה לחיזוק הכוח הצבאי — למשל תוכנית של דארפ"א שהושקה בשנה שעברה, להפעלת נחילי רחפנים באמצעות מחשבה.

המידע שאוספים היום לא נעלם. אם היום אנחנו יודעים לקרוא רק מעט מהמידע שנאסף בטכנולוגיות מיפוי מוח, בעוד 20 שנה, עם ההתקדמות בחומרה ובמודלים, נוכל לקרוא יותר"

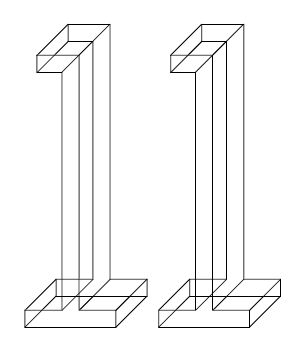

מגילת זכויות המוח

ארבע זכויות האדם החדשות לעידן הדיגיטלי

עפ"י ד"ר מרצ'לו איינקה

הזכות לחירות קוגניטיבית

לאנשים שמורה הזכות להחליט אם לאפשר לכלים נוירו־טכנולוגיים לפעול על המוח שלהם

הזכות לפרטיות מנטלית

לאנשים שמורה הזכות להחליט אם לאפשר איסוף מידע מהמוח שלהם, איזה מידע ומי יוכל לעשות בו שימוש

הזכות לשלמות מנטלית

לאנשים שמורה הזכות להגן על עצמם מפגיעה פיזית או פסיכולוגית שהנוירו־טכנולוגיה עלולה לגרום

הזכות להמשכיות פסיכולוגית

לאנשים שמורה הזכות להגן על הזהות שלהם, על העצמי שלהם, משינויים הנכפים עליהם מבחוץ

האמצעי הראשון להתמודד עם כל האיומים האלה הוא להתחיל להכיר את הנושא, לפתח מודעות לרגישויות ולדרוש שקיפות ונגישות למידע. כבר היום, איינקה מזכיר, "אנשים מוכנים לסחור בפרטיות שלהם אם את מספקת להם שירות טוב. אבל כדי שהם יוכלו לקבל החלטה בנוגע לזה חייבים לספק להם מידע אמין. ובתחום הנוירו־טכנולוגיה חברות רבות מגזימות בטענות השיווקיות שלהן, מבטיחות להפחית את רמות הלחץ, לגרום לך ללמוד מהר יותר או לזכור יותר דברים, ואין שום עדויות שזו האמת. אם מייצרים ציפיות לא מציאותיות, זה עלול להטעות אנשים ולגרום להם להסכים לשתף מעצמם יותר. צריך גם ליידע אנשים היכן המידע נשמר, מי מקבל גישה אליו, ואם החברה מוכרת את המידע. ברגע שמאפשרים לאנשים לקבל החלטות על בסיס יותר ידע בנושא, זה בסדר שהם יבחרו לסחור בחלקים גדולים מהמידע שלהם".

מתוקף זכותנו

גם אז, צריכה להיות מסגרת בסיסית של זכויות שתבטיח שאנשים יוכלו לבחור. זכויות אדם, לא פחות. ב־2017 פרסמו איינקה ופרופ' רוברטו אנדורנו, משפטן ומומחה לזכויות אדם, מאמר שזכה לסיקור נרחב ומצוטט מאז בכל דיון בנושא. השניים הגדירו בו ארבע זכויות אדם חדשות, על בסיס הרעיון שכפי שחירותו הפיזית של האדם היא זכות בסיסית אשר יש לשמור עליה, גם החירות המחשבתית שלו צריכה להיות מוגדרת כזכות השמורה לכל בני האדם.

ואמנם, הזכות הראשונה שהוגדרה היא הזכות לחירות קוגניטיבית. "כל המסמכים הקיימים שעוסקים בזכויות אדם מדברים על חופש המחשבה, אבל מה שהם באמת מתייחסים אליו הוא חופש לתוצרי הלוואי של המחשבה — חופש דת או עמדות פוליטיות", מסביר איינקה. "כעת יש צורך לכייל את הזכות הזו באופן יותר רחב ובסיסי, כך שתגן על המחשבות האנושיות, על הנוירו־ביולוגיה שלהן. הזכות לחירות קוגניטיבית היא בעצם ההבטחה שלאנשים יהיו הזכות והאפשרות לקבל החלטות מודעות על המוח. צריך להבטיח שיהיה להם החופש להחליט אם הם רוצים לגרות את המוח שלהם או שהם מסרבים לנטר אותו".

הזכות השנייה נוגעת לפרטיות מנטלית. "הפרטיות כמובן מעוגנת בחוק הבינלאומי, אבל שוב מדובר על מידע פרטי שאנשים מוציאים החוצה בעצמם. פרטיות מבוססת על ההנחה שלכולנו יש היכולות לסנן את המידע שיוצא החוצה, ושיש לנו הזכות להחליט איזה מידע אנחנו רוצים לשתף. כשזה נוגע לפעילות מוחית אנחנו מאבדים את היכולות הזאת, כי גלי מוח, ברוב המקרים, נמצאים מתחת לסף השליטה המודעת שלנו. יש טכנולוגיות שיכולות לאסוף מידע מהמוח שלנו ללא ידיעתנו או הסכמתנו, לכן צריך לדבר על הזכות לפרטיות מנטלית".

שתי הזכויות הנוספות עוסקות בשלמות המנטלית ובהמשכיות הקוגניטיבית, ו"נועדו להבטיח שאנשים יוכלו להגן על זהותם משינויים חיצוניים, לסרב לשינויים בתפקודי המוח שלהם. הן אמורות להגן עלינו מפני האפשרות שייעשה שימוש לרעה בטכנולוגיה כדי לעשות מניפולציות על הפעילות העצבית שלנו".

ארבע הזכויות האלה, מסביר איינקה, אמורות להעניק מעטפת הגנה רחבה בתחום פרוץ לחלוטין, ללא אמות מידה מקובלות ובלי שום רגולציות. "אין שום סימן להסכמה משותפת בין השחקנים בתחום — לא בנוגע לכללים, לא בנוגע לאופן שבו יש ליישם אותם, לא בנוגע לכלים הנדרשים כדי להבטיח אתיקה בסיסית", הוא אומר. וכשהוא מתאר את המצב כך, ברור למה הוא מנסה, בדחיפות, לכונן קווים מנחים כלשהם כקו הגנה ראשון.