וידויים של מוח מסוכן

מה שאנחנו מכנים "אינטליגנציה מלאכותית" הוא לא אינטליגנציה ולא מלאכותי: מאחורי המונח הנוצץ הזה מסתתרים כלים שיצירתם תלויה בהרס ובניצול, ושאינם מבינים את משמעותו של המידע העצום שנדחס בהם, טוענת ד"ר קייט קרופורד, מבכירות חוקרי ה־AI בעולם. בראיון בלעדי למוסף כלכליסט היא מסבירה למה הציפייה ש־AI ינתח את האישיות שלנו מחזירה אותנו לתורת הגזע, ומזהירה שהכוח שאנו מפקידים בידי מחשבים יוביל לאוטומציה של אפליה ודיכוי

חומר למחשבה

ויקי אוסלנדר

איור: דין לנר

להאזנה לכתבה

הוקלט על ידי הספריה המרכזית לעיוורים ולבעלי לקויות קריאה

ה

ריחוק החברתי שנכפה עלינו בשנה החולפת הוביל לאימוץ מהיר, כמעט לא סלקטיבי, של שלל מוצרי טכנולוגיה לזיהוי רגשות. מגייסי כוח אדם הפעילו כלים כאלה כדי להעריך מועמדים בריאיון מרחוק; מוסדות לימוד הטמיעו אותם במאמץ לעקוב אחרי רמות הקשב של התלמידים בזום; חברות ביטוח הפעילו אותם כדי לזהות ניסיונות הונאה; בעלי קניונים ונמלי תעופה השתמשו בהם כדי לנסות למנוע פשיעה.

מה שנמצא בלב הטכנולוגיות הללו הוא מערכות בינה מלאכותית (AI), שנחשפו למיקרו־הבעות ותווי פנים של מיליוני בני אדם, ולכאורה למדו לזהות שישה סוגי רגשות אנושיים: אושר, עצב, כעס, גועל, הפתעה ופחד. הטענה היא שהמערכות מזהות בהבעות הפנים עדויות למתחולל בנפשו של אדם. אבל האמת המורכבת יותר היא שעד כה לא הוכח שהמערכות הללו אכן מסוגלות לזהות רגשות. יותר מכך: קיימת מחלוקת מדעית עמוקה אם בכלל קיים ביטוי מולד, עקבי, מדיד וחוצה תרבויות להבעות פנים.

מבחינת ד”ר קייט קרופורד (Crawford), האימוץ המהיר של הטכנולוגיות הללו הוא עוד המחשה למימרה שלפיה ההיסטוריה אינה חוזרת על עצמה, אבל היא מתחרזת. “החריזה מתבטאת בהבטחה שמערכות בינה מלאכותית יכולות למדוד את פניו של אדם ולומר אם יש לו נטייה לפשע, או שהן יכולות להתבסס על תמונה ולנבא את הנטייה המינית שלו”, אומרת קרופורד, מבכירות ההוגים בתחום הבינה המלאכותית, ומי שייעצה לבית הלבן ולאיחוד האירופי ולימדה בכמה מהמוסדות האקדמיים המובילים בעולם. “זה משקף דחף אנושי לנסות להגדיר את אישיותו, זהותו וערכו של אדם בהתבסס על מבנה הגולגולת והפנים, המראה החיצוני או צורת הגוף. השאלה היא למה שנשתמש בכלים שלוקחים אותנו בחזרה להיסטוריה של תורת הגזע למטרות האלו”.

קרופורד. “המונח ‘בינה מלאכותית' מעניק לטכנולוגיה נופך מיסטי, שמקשה עלינו להפעיל את חוש הביקורת"

בספרה החדש, “Atlas of AI”, קרופורד משרטטת היטב את הקווים שמחברים בין בינה מלאכותית לבין פסיאודו־מדע כמו פרנולוגיה (ניתוח אופי לפי מבנה הגולגולת) או אֵאוּגֶנִיקָה (התורה להשבחת הגזע). באמצעות חקירה היסטורית של הרעיונות והשיטות המדעיות והמדעיות־לכאורה בתחום, מפרויקט מדידת הגולגולת של סמואל מורטון במאה ה־19, דרך עבודתו של מדען הטילים הנאצי ורנר פון־בראון, ועד חקירת תווי הפנים של פול אקמן בפפואה ניו גיני בשנות השבעים, היא מפרקת בקפדנות שומטת לסתות כמה מהמיתוסים הגדולים בתחום, וחותרת למסקנה אחת מהדהדת: מה שלמדנו לכנות “אינטליגנציה מלאכותית” הוא לא אינטליגנציה ולא מלאכותי.

אז מה זה כן? בריאיון בלעדי ל”מוסף כלכליסט” קרופורד מנקה מהטכנולוגיה את ההילה המופשטת שמעניקה לה המילה “אינטליגנציה”, ומזכירה שמדובר בסך הכל במכשיר. “זו טכנולוגיה מטריאלית לחלוטין”, היא מסבירה. “ניתן לראות זאת באמצעות איתור כל הרכיבים שכלולים במערכות העיבוד העצומות האלה, וכל המשאבים הטבעיים, האנרגיה והעבודה שמושקעים כדי לייצר אותן.

“המערכות גם אינן אינטליגנטיות באופן שבו אנחנו מבינים אינטליגנציה אנושית: הן לא מסוגלות להבחין בדברים ללא הכשרה אנושית נרחבת, ויש להן היגיון סטטיסטי שונה לחלוטין בנוגע לאופן שבו נוצרת משמעות. אבל מאז שנות החמישים, אנחנו חיים בעידן שבו אנחנו מסתכלים על מדעי המחשב כאילו הם ייצוג של האופן שבו פועל המוח האנושי. הגישה הזו זיהמה את החשיבה בתחום במשך עשרות שנים”.

הטענה של קרופורד עלולה להישמע פשטנית, אבל מדובר במהלך עקרוני שנועד להרחיק את הטכנולוגיה מהמיסטיקה ומהסיפורים על הגאונים שיצרו אותה, להחזיר אותה מהענן לקרקע — ובסופו של דבר לראות אותה כפי שהיא באמת: כזו שנולדה מחומרים שהופקו מאגמי המלח בבוליביה וממכרות בקונגו, שנבנתה על ידי עובדי קבלן בשכר נמוך, ושנשענת בחלקה על מדע שהוא פשוט רע. רק כשנשלים עם זה, היא אומרת, נוכל להתוות עתיד צודק ובר־קיימא עם AI.

היית מעדיפה שהביטוי “אינטליגנציה מלאכותית” ייזנח ויוחלף?

“המונח הזה הוא מלכודת, דרך ללא מוצא. זו מטאפורה שגויה למה שהכלים האלו עושים, ולאיך שהם עושים אותו: היא מעניקה לטכנולוגיה נופך קסום, כמעט־אלוהי, ובאותו זמן דטרמיניסטי, במובן זה שהיא יכולה לקבל החלטות מכריעות על החיים שלנו, בשאלות כמו את מי להעסיק, מי צריך להיות בכלא. הנימה הזו מעוורת אותנו לאופן שבו עלינו להיות ביקורתיים יותר כלפי המערכות האלו. אם במקום ‘אינטליגנציה מלאכותית’ היינו קוראים להן ‘אופטימיזציה סטטיסטית בקנה מידה גדול’, אולי אנשים היו אומרים ‘אה, זה עלול להיות רע’”.

"ניסיתי לספק לקוראים הצצה למנגנון שמאחורי ה־AI. זה קריטי, כי הטכנולוגיה הזו הופכת לעניין דמוקרטי: לאנשים יש זכות לבחור אם הם רוצים מערכות כאלה בבית הספר, בבית החולים, בממשל. הם צריכים להבין שיש בזה טוב ורע"

עובד במכרה קובלט בקונגו. הפקת טונה אחת של חומרים לטכנולוגיה מייצרת 76 טונות של חומרים רעילים

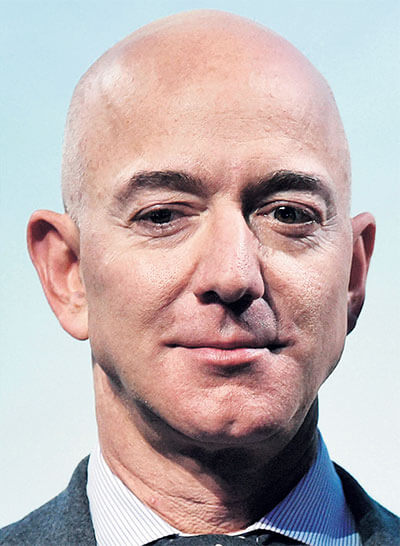

רקטה של “בלו אוריג'ין" של ג’ף בזוס. אחרי שבזזו את כדור הארץ, ברוני ה־AI רוצים לבזוז גם את מערכת השמש. צילומים: אימג'בנק /Gettyimages, Cath Muscat

מה יקרה כשהמינרלים שבבסיס הטכנולוגיה ייגמרו?

קרופורד (45) חוקרת כבר 20 שנה את ההשלכות החברתיות של בינה מלאכותית. היא חלק מקומץ חוקרות נועזות ובולטות בתחום (לצד טימניט גברו, וונדי הול, סופיה נובל, מרגרט מיטשל וקשמיר היל), שמציעות את הביקורת המורכבת ביותר בתחום בעשור האחרון. היא מייסדת שותפה של מכון AI Now ב־NYU, החממה האינטרדיסציפלינרית המובילה בעולם בנושאי אתיקה ו־AI; ייעצה לנשיא אובמה ולאיחוד האירופי; כיהנה כיו”ר המכון לבינה מלאכותית ולצדק באקול נורמל סופרייר בפריז; וכיום משמשת פרופסור באוניברסיטת דרום קליפורניה, וחוקרת בכירה ראשית בקבוצת FATE של מיקרוסופט (קבוצה בחברה שחוקרת את ההשלכות החברתיות של AI ולמידת מכונה כדי להבטיח שהפיתוחים בתחום יהיו אתיים).

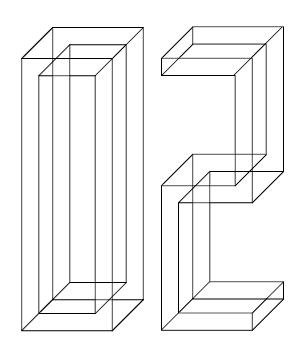

בקריירה עטורת ההישגים הזו יש שורה אחת יוצאת דופן: קרופורד חתומה על עבודת אמנות שהוצגה ביותר מ־80 מוזיאונים ברחבי העולם. בעבודה “אנטומיה של AI”, היא והאמן הסרבי ולדאן ג’ולר פירקו את החומרים שנדרשים לבניית אֶקוֹ, הרמקול החכם של אמזון שמתהדר בסייעת הווירטואלית אלקסה — “AI קולי”, כפי שהשירות מוגדר בחברה. “איתרנו את כל החלקים המרכיבים את האקו”, היא מספרת, “חקרנו מהיכן הם מגיעים, איפה כורים אותם, איך מובילים אותם ובסוף חייהם — היכן מטמינים אותם. לקח לנו שנתיים לעקוב אחר שרשרת האספקה במלואה, מלידה ועד מוות”. את ערמת התשתיות הזו, שגורמת לאלקסה להיראות כמו קסם, הם הציגו על תרשים גדול ממדים שנרכש על ידי מוזיאון ה־MoMA בניו יורק ומוזיאון ויקטוריה ואלברט בלונדון, והפך חלק מהתצוגה הקבועה בשני המוסדות הללו.

המחקר שהפך אמנות היה רגע של שינוי עבורה. “הבנתי שאם אני יכולה לעשות את זה עבור אלקסה אחת, אני צריכה לעשות מיפוי דומה לכל תעשיית ה־AI”, היא מספרת.

מהמיפוי הזה עולה תמונה עגומה במיוחד. התעשייה הזו, שחודרת לכל היבט בחיים המודרניים, עומדת על פי תהום. ב־2020, קבוצת גנאולוגים פרסמה אזהרה חמורה: 23 מינרלים חיוניים למגזר הטכנולוגיה הגיעו לסף ניצול מוחלט. עם אלו נמנים דיספרוזיום וניאודימיום, שמשמשים ברמקולים של האייפון ובמנועי רכב חשמלי; גרמניום, שמצוי במכשירי אינפרא־אדום; קובלט, שמשפר את ביצועי סוללות הליתיום; ועוד 17 חומרים נדירים שמשמשים ביצירת מערכות תקשורת, סיבים אופטיים, מגדלי תקשורת, מחשבים ניידים וטלפונים חכמים.

בעשור האחרון, החומרים הללו הפכו ל”מינרלי דם”, כמו יהלומי הדם, כשהם נכרים באלימות באזורי סכסוך. הנדירות שלהם מחייבת תהליכי כרייה מאסיביים והרסניים להפקת מעט מאוד חומר. בתהליך כריית דיספרוזיום וניאודימיום, למשל, רק 0.2% מהחימר שנכרה מכיל את המתכות. האגודה הסינית למינרלים נדירים מעריכה שהפקת טוֹנה אחת של החומרים הללו מייצרת 75 אלף ליטר של מים חומציים וטוֹנה אחת של שאריות רדיואקטיביות; התהליך הזה כבר זיהם אגמים רבים בסין, אינדונזיה, מלזיה, סינגפור ואפילו ארצות הברית, והפך את סביבותיהם ללא ראויים לבני אדם.

אם מינרלים הם עמוד השדרה של ה־AI, נשמת חייה היא החשמל שנדרש כדי להפעיל את חוות השרתים ומרכזי הנתונים — וגם אלה מזהמים. תשתיות החישוב מייצרות טביעת רגל פחמית זהה או אף גדולה מזו של תעשיית התעופה בשיאה, והיא צומחת בקצב מסחרר: עד 2040 היא תהיה אחראית ל־14% מכל פליטת גזי החממה העולמית. כבר כיום, מציינת קרופורד, הפעלת מודל אחד של עיבוד שפה — למשל צ’אטבוט או שירות תרגום דיגיטלי — מייצרת פליטת פחמן דו־חמצני בכמות שוות ערך ל־125 טיסות הלוך ושוב מבייג’ינג לניו יורק. אמזון לבדה מפעילה 43 מודלים כאלו.

כל המספרים הללו הם רק הערכות. “הכמות המדויקת של צריכת האנרגיה המופקת על ידי מודלי ה־AI אינה ידועה”, כותבת קרופורד. “המידע הזה הוא סוד תאגידי שנשמר באדיקות. גם כאן כלכלת הנתונים נשענת על יצירת בּוּרוּת סביבתית”.

ב”Atlas of AI”, במאמץ להתרחק מההווה המופשט של ה־AI, קרופורד יוצאת למסע במרחב גיאוגרפי ממשי. היא מגיעה למכרה האמריקאי האחרון של ליתיום, “הזהב האפור”, ולעיירות הכורים שלו, שננטשו אחרי שכילו את משאבי האזור והרעילו את מאגרי המים; משקיפה על חוות השרתים של ה־NSA ביוטה, שמנצלת יותר מ־6.4 מיליון ליטר מים מדי יום; מבקרת במטמוני האשפה האלקטרונית בגאנה ובפקיסטן; ומנסה להתקרב לאתר השיגור של בלו אוריג’ין, חברת החלל של ג’ף בזוס. “המסע משמש דרך להבאת הסיפורים האלו לאנשים”, היא אומרת, ומדגישה את הצורך הגדול לתקשר עם הסביבה. “AI הוא נושא שנראה כל כך מסובך, קשה להבנה ומנותק. בעבודה שלי, אני מנסה לספק לאנשים חרך שדרכו יוכלו לראות איך זה עובד ולגבש את דעתם. וזה חשוב מאוד, כי טכנולוגיות AI הופכות לעניין של דמוקרטיה. לאנשים צריכה להיות הזכות לבחור אם הם רוצים את המערכות האלו בבתי הספר שלהם, בממשלות שלהם, בבתי החולים שלהם. הם צריכים להבין שיש בזה טוב ורע”.

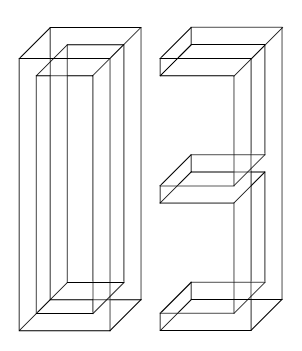

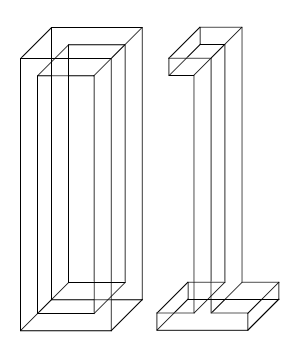

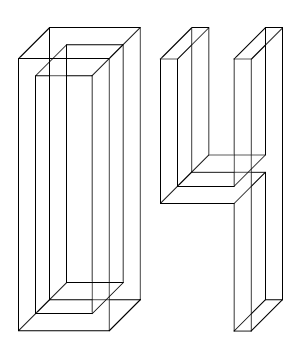

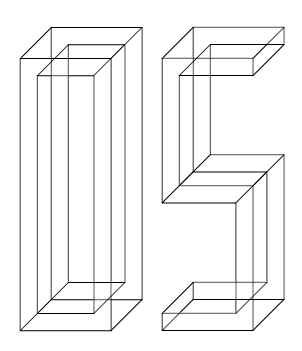

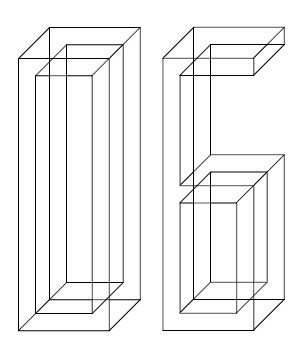

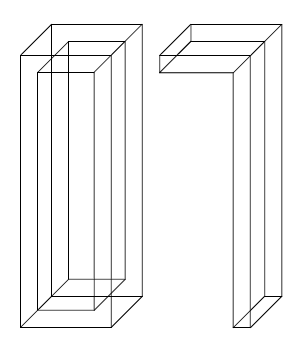

תחנות בחייה של בינה מלאכותית

"אנטומיה של בינה מלאכותית", עבודתה של קרופורד שנרכשה על ידי כמה מטובי המוזיאונים בעולם, עוקבת אחרי ייצורו של Echo, הרמקול ה"חכם" של אמזון. התרשים מחולק לשלושה שלבים: משמאל שרשרת הייצור והאספקה, באמצע אימון מערכות הבינה המלאכותית, ומימין התוצר הפיזי של הפסקת השימוש. כל שלב מוצג עם הנזקים והסיכונים שנובעים ממנו

1. המוצר המוגמר: אמזון Echo, רמקול המצויד בבינה מלאכותית, המציית לפקודות בסיסיות

2. 100 דולר בחודש | שכרם של עובדי פינוי פסולת אלקטרונית (הודו)

3. 1,300 דולר בחודש |שכרם של עובדי פס ייצור (סין)

4. כריית עפרות | נזקים: הרס סביבתי, עבודת כפייה, פעילות באזורי קונפליקט

5. הפקת מינרלים נדירים |נזקים: עיסוק בפסולת חומצית ורדיואקטיבית

6. ייצור רכיבי מחשב | נזקים: יצירת פסולת רעילה

7. הרכבת המוצר הסופי | נזקים: הפרת זכויות עובדים

8. שינוע ללקוחות | נזקים: זיהום אוויר

9. אימון מערכת המחשב | נזקים: הזנה של הטיות תרבותיות

10. תום השימוש |נזקים: שימוש במטמנות לפסולת אלקטרונית

לגירסה באיכות גבוהה

לאתר של קרופורד: https://anatomyof.ai

השקרים שמתדלקים את ענף ה־AI הושמעו כבר במאה ה־18

בטיעון של קרופורד על המטריאליות של הטכנולוגיה יש משהו כמעט מובן מאליו, ובכל זאת גם כלל לא. הדיון על ההשלכות האקולוגיות של בינה מלאכותית מוסתר כמעט לחלוטין. כשמדובר בביטקוין, אנחנו כבר מכירים בכך שמדובר בטכנולוגיה שצורכת כמויות עצומות של אנרגיה — אבל AI עדיין נתפס אצלנו כמשהו אבסטרקטי. אם תחפשו את הביטוי “בינה מלאכותית” בשירות התמונות של גוגל, תקבלו תמונות של מספרים כחולים ורובוטים דמויי אדם (תמיד לבנים, אגב). “משווקים לנו את ה־AI כטכנולוגיה תיאורטית, מנותקת מגוף, שנמצאת בענן”, מסבירה קרופורד, אבל השיווק הזה הוא חלק ממאמץ מכוון שנועד לאפשר לתעשייה להמשיך לכרות משאבים באגרסיביות, העיקר להמשיך להתקיים. “גריי ברקין (Brechin), היסטוריון של האדריכלות, מציע לנו לחשוב על גורדי שחקים כעל ‘נופים הפוכים’”, היא משתמשת במטאפורה: “המחצבים שהופקו מחורים באדמה נמכרו כדי ליצור את הסיפורים שתלויים באוויר”.

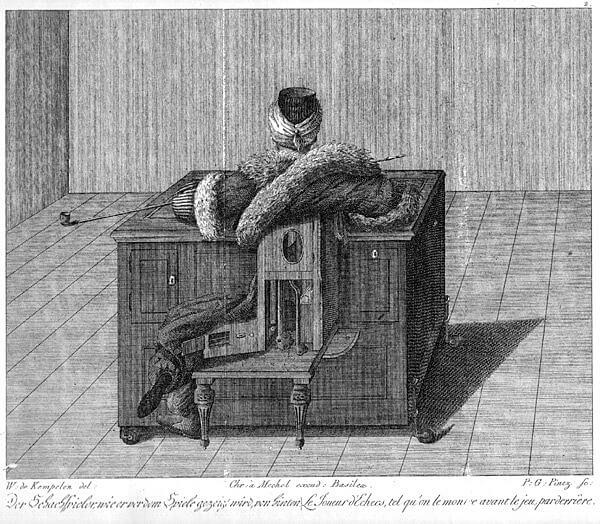

אבל זו לא רק המטריאליות: ההצגה של הטכנולוגיה כ”אינטליגנציה” היא אחיזת עיניים. כבר ב־1770, מזכירה קרופורד, המציא ההונגרי וולפגנג פון־קמפלן את “הטורקי המכני” (Mechanical Turk), בובת עץ בגודל טבעי, ששיחקה וניצחה במשחקי שחמט נגד יריבים אנושיים. “הטורקי” — לבוש טורבן, מכנסיים רחבים וחלוק פרווה שסיפקו רושם של מכשף אוריינטלי — נדד ברחבי אירופה והוצג בהיכלות מלכים כמכונה אינטליגנטית אמיתית. האמת, שהוסתרה בקפדנות במשך 88 שנה, היתה שבתא פנימי במכונה הסתתר אמן שחמט אנושי שהפעיל אותה. כשנחשף הסוד, הפך “הטורקי” שם נרדף לנכלוליות.

235 שנה מאוחר יותר, ללא שמץ של מבוכה, השיקה אמזון את Amazon Mechanical Turk (ובקיצור MTurk), שירות שמאפשר ללקוחותיו לבצע מיקור חוץ של מיקרו־מטלות וירטואליות פשוטות, כמו למיין תמונות לפי שמות עצם, לענות על סקרים, למלא שאלונים או לתמלל דקה של אודיו. השירות הזה מסתמך על אלפי עובדים “לא מיומנים”, שמחקר מ־2019 מצא ששכרם השעתי הממוצע הוא 2 דולר; רק 4% מהם הצליחו להרוויח יותר משכר המינימום (7.25 דולר). אמזון גובה 20% עמלה מהמחיר שמשלם הלקוח.

ג’ף בזוס, מייסד אמזון, כינה את MTurk “בינה מלאכותית מלאכותית” — “וזה בעצם אומר אנשים”, מדגישה קרופורד את הלא־ייאמן. “אלו אנשים שעובדים כדי שמכונות יוכלו להיראות כאילו הן אינטליגנטיות. זה טריק. כשאת מסיטה את הווילון, את מגלה שלא מדובר בקסם של AI, אלא באלפי עובדים שמשתכרים גרושים כדי לגרום למערכות הללו לעבוד”.

אבל בכך לא תם תפקידו ההיסטורי של MTurk. מערכות בינה מלאכותית זקוקות למערכי נתונים עצומים מסווגים לקטגוריות, שמהם הן לומדות באמצעות הסקה סטטיסטית; כך, למשל, כדי שרחפן אוטונומי יוכל לזהות מטרה צבאית, חושפים את המערכת למערך ויזואלי עצום שמוגדר על ידי פרמטרים, ו”מלמדים” אותה “להבחין” בין דמותו של חייל לאזרח. כדי לעשות זאת, חברות רבות פונות ל־ImageNet, מערך הנתונים הוויזואלי הפומבי הגדול ביותר, שפותח באוניברסיטת פרינסטון בראשות החוקרת ד”ר פיי־פיי לי. לי וצוותה קצרו מהאינטרנט 14 מיליון תמונות, שאותן רצו לסווג ל־20 אלף קטגוריות לפי שמות עצם. המשימה הזו נראתה בלתי אפשרית — לאוניברסיטה לא היה את כוח האדם והזמן הנדרש — עד שהחוקרים שמעו על MTurk. “לי אמרה, ‘ברגע שהראו לי את האתר, הבנתי שהפרויקט הזה יוכל להיות מעשי”, כותבת קרופורד.

כשהמשימה הוטלה על MTurk, עובדים מכל העולם החלו בפעילות הסיווג של שמות העצם, כשהם עוברים בממוצע על 50 תמונות בדקה. העניין הוא שלא כל הקטגוריות היו פשוטות כמו תפוח או מטוס: היו בהן 2,833 תת־קטגוריות של בני אדם — ושם כבר ניכרות תפיסות עולם בנוגע לגזע, לאום, מקצוע, מעמד כלכלי, התנהגות ואף מוסר. עובדי אמזון נדרשו לסווג תמונות לפי קטגוריות מופשטות כמו “צבוּע”, “אדם רע” או “רמאי”. חלק מהקטגוריות שיקפו גזענות ומיזוגיניות, כמו “פרימדונה”, “גבר”, “רווקה זקנה”, “נואפת” או “סוטה”. אלו תמונות של אנשים רנדומליים שנאספו מהאינטרנט ללא רשותם, ותויגו במבט שטחי כמגדירות את הלאום, המגדר, הנטייה המינית או המוצא שלהם.

זה נשמע כמו מעגל של הונאה.

“ברגע שמפסיקים לזהות מידע כבעל ערך, מתעלמים מהמקורות וההקשרים שלו, ומתייחסים רק לגודל המידע — פתאום הייחודיות שלו אובדת, והוא הופך רק לתשתית.

“הטענה ש’ככל שנקצור יותר מידע מהאינטרנט כך המערכות שלנו יהיו חכמות יותר ולכן עלינו לקצור הכל’ היא מהלך אידאולוגי. איסוף מקסימום של מידע הופך כמעט לציווי מוסרי — לא משנה כמה הוא חושף אנשים לסיכונים, אם זו חדירה לפרטיות, אם זה מייצר AI שיפלה בעתיד, אם זה ירדוף אנשים בעתיד. אנחנו רואים שוב ושוב שהמידע הזה משמש בדרכים רבות שלא חשבנו עליהן — למשל בידי חברות ביטוח, או בידי מעסיקים”.

"לפני 235 שנה הומצא 'הטורקי המכני', מכונה שלכאורה שיחקה שחמט, אך בתוכה הסתתר שחקן אנושי. אמזון עושה את אותו הדבר: היא מוכרת שירות שמבצע מיקרו־מטלות ומשווקת אותו באריזת AI, אבל הוא מתבסס על עובדים בשכר רעב"

גולגולת שעליה מוצגות תכונות על פי “התיאוריה" הפרנולוגית. “הדחף לקבוע את ערכו של אדם לפי מבנה הגולגולת התגלגל לציפייה ש־AI ינתח את תמונתו ויעריך את נטייתו לפשע". צילום: Niccolo Caranti

תחריט של “הטורקי המכני". השקר שבבסיס הבינה המלאכותית נותר אותו שקר, רק המכונה השתכללה

מזינים את המחשב בדעות קדומות, ומניחים לו לנהל אותנו

העקשנות של קרופורד השתלמה, חלקית. חשיפת הסיווגים האלימים האלו יצרה הד ציבורי ודחקה את ראשי ImageNet לבחון מחדש את קציר התמונות וסיווגן. בשנה שעברה הם הודיעו שימחקו 6% מהקטגוריות ויסירו 600 אלף תמונות שנמצאו פוגעניות. זה לא פתר את הבעיה הבסיסית: כל שאר מערכי הנתונים נתפסים כתשתית חסרת הקשר, וכל השאלות עדיין שם — מה קורה כשאנחנו מסווגים אנשים כמו חפצים, כשעוברים מתיאור פיזי לתיאור ערכי? ומי מבצע את הסיווגים הללו?

השאלות האלו הולכות והופכות דוחקות ככל שגובר השימוש בטכנולוגיה לטובת מעקב ומשטור של המרחב הציבורי. גילויים קיצוניים כאלו מגלים הרבה על הכוחות המניעים של הטכנולוגיה, שמצליחים לשווק אותה כמוצר מלאכותי, חכם וירוק. הסוד, מסבירה קרופורד, הוא הקשר למדינה.

“יש קומץ של מדינות שהן אימפריות AI (כיוון שרק חברות ענק כמו גוגל, אמזון ומיקרוסופט מחזיקות במערכות AI, ו”א), ויתר העולם קונה מהן שירותים”, היא אומרת. “זו מערכת יחסים מורכבת: לטכנולוגיות האלה יש היסטוריה צבאית, והיא חלק מהקשר בין החברות שמפתחות AI לבין המדינות שבהן הן פועלות. חלק מהחברות הללו צברו עוצמה שווה לזו של המדינה או אף עולה עליה, ולעתים הן מנסות ליטול חלק מהתפקידים שלה. לעתים יש גם שיתוף פעולה בין הצדדים הללו, שמתבסס על ציר של צרכים לאומיים. הכוח העצום של החברות הללו מתבטא גם בתת־רגולציה שהן נהנות ממנה”.

קחו לדוגמה את גוגל, אמזון ומיקרוסופט, שנלחמות על חוזים ממשלתיים גם כאן בישראל ומנסות למכור שירותי ענן לתעשייה הביטחונית, שמצדה משתמשת באותן מערכות “חכמות” כדי להפעיל מל”טים במשימות צבאיות. משא ומתן עם חברות כאלה מתנהל כדרך קבע כחלק מוויכוח גדול יותר בנוגע לשמירה על אינטרסים ביטחוניים לאומיים. בישראל הרי לא יעלה על הדעת לקנות שירותים כאלו מעליבאבא הסינית, למשל.

ובכל זאת, השיחה עם קרופורד מתקיימת בעיתוי ייחודי, רק יומיים אחרי שהנציבות האירופית פרסמה מסמך יוצא דופן — כללים להסדרת טכנולוגיית AI “בגישה שממוקדת בבני אדם”. הכללים, שיהפכו בחודשים הקרובים לחוק, ידרשו מחברות שמפעילות מערכות AI לציית לכללי שקיפות מחמירים, שכוללים פיקוח אנושי על מערכי הנתונים שבאמצעותם מאומנות המערכות, כדי להבטיח שהן אינן מוטות. כדי לא להישאר לגמרי מאחור, פרסמה רשות הסחר האמריקאית (FTC) אזהרה, שלפיה כלי AI שמשקפים הטיות מגדריות וגזעיות עלולים להפר את חוקי הגנת הצרכן.

“זו הפעם הראשונה שבה יש ניסיון להסדיר מערכות בינה מלאכותית ולחשוב על ההשלכות הרחבות על האוכלוסייה”, אומרת קרופורד על המהלך האירופי. “לחברות האלו היה כל כך הרבה עוצמה במשך כל כך הרבה זמן, שאנחנו רק מתחילים להדביק את הקצב ולהבין איך תיראה רגולציה הולמת לתעשייה כה עוצמתית ורבת־השפעה”.

"כשאנחנו קוראים למערכות כאלה 'בינה' ומניחים שהן יפתרו את הבעיות שלנו, ממש מתבקש שנרוץ לכרות מידע ולאמן אותן באמצעותו. אבל בסוף המידע הזה הוא מוטה, ויכול לשמש נגדנו באופנים שאנחנו עוד לא מבינים"

ג'ף בזוס ואלון מאסק. קומץ גברים סופר־עשירים מנצל ידע שגובש על חשבון הציבור. צילומים: אי.אף.פי

במקום לעצור את מרוץ ניצול המשאבים, לוקחים אותו לחלל

כשקרופורד מדברת על “להחזיר את הטכנולוגיה הזו לקרקע”, היא מתכוונת לכך גם פשוטו כמשמעו. את החלק האחרון בספרה היא מקדישה למרוץ לחלל של ברוני הטכנולוגיה אלון מאסק וג’ף בזוס: אחרי שעשו את הונם על ידי ביזה של משאבי כדור הארץ, ממינרלים ועד כוח עבודה, עברו שני אלה להתרכז בפרויקטים פרטיים באמצעות החברות הפרטיות ספייס־אקס (של מאסק) ובלו אוריג’ין (של בזוס), כשהם תולים את תקוותם בירח ובמאדים, שם לטענתם יש לתכנן את ההתיישבות הגדולה הבאה.

מבחינת מאסק, הכוח המניע במרוץ הזה הוא החשש שבינה מלאכותית, שהוא לוקח חלק בבנייתה, תהפוך חזקה מהאדם ותשעבד אותו. מבחינת בזוס, הסכנה “אינה בהכרח הכחדה, אלא קיפאון” — מיצוי של משאבי כדור הארץ שיביא לבלימת הצמיחה. אבל את המרוץ הזה לחלל מנחה אותה אידאולוגיה שעומדת מאחורי ה־AI, טוענת קרופורד, שמזכירה ציטוט של חלוץ מדע הטילים ורנר פון־בראון: “ברגע שהטילים למעלה, למי אכפת היכן הם נוחתים”. כוח ועושר קיצוניים מאפשרים לקבוצה קטנה של גברים להשתמש במימון ממשלתי ובתמריצי מיסוי כדי לנצל את הידע והתשתיות שנצברו בתוכניות הציבוריות של כיבוש החלל. מטרתם של האנשים הללו היא לא להגביל את השימוש במשאבים כדי להשיג עתיד בר־קיימא, אלא להרחיבו על פני מערכת השמש.

“הדבר המעניין עבורי הוא שיש אנשים דיסטופיים שחושבים על ‘הסינגולריות’, הרגע שבו טכנולוגיה תתקומם ותגבר על האנושות, ומולם יש אנשים אוטופיים שרואים בטכנולוגיה כלי לפתרון כל הבעיות, מבריאות וחינוך ועד שיטור, כאילו שזה מפתח אוניברסלי להכל. שתי הפרספקטיבות האלו בעייתיות, משום שהן מותירות את הטכנולוגיה במרכז: היא או המקור לכל הבעיות, או הפתרון לכל הבעיות. אבל אנחנו צריכים לקחת צעד אחורה, להתבונן בבעיות מהותיות כמו משבר האקלים, זכויות העובדים, פרטיוּת — ולשאול איך אנחנו מתמודדים איתן. אנחנו צריכים לשאול את עצמנו באיזה עולם אנחנו רוצים לחיות, במקום לתת לטכנולוגיה להניע את האג’נדה הזו”.

הכל נשמע עגום מאוד.

“אחד הדברים שמותירים אותי אופטימית הוא הקריאות לצדק גזעי בארצות הברית, הקריאות לצדק סביבתי באירופה, והקריאות להגנה על פרטיות שנשמעות במדינות מתפתחות. אני מזהה אג’נדה גלובלית, תנועות פוליטיות שפעלו בנפרד, וכעת מתגבשות יחדיו ובוחנות כיצד אפשר לבנות עולם טוב יותר”.